һλ���Ї����Z���ϵK�����ӣ��������Xֲ���b�Ì��F�������fԒ�質��ԓ���Xֲ����������r�،���������D�������Z�����H�܂��_�����Z�{׃�������{���x��Ć��~�������܉����߳�����3�N���߽M�ɵ�������

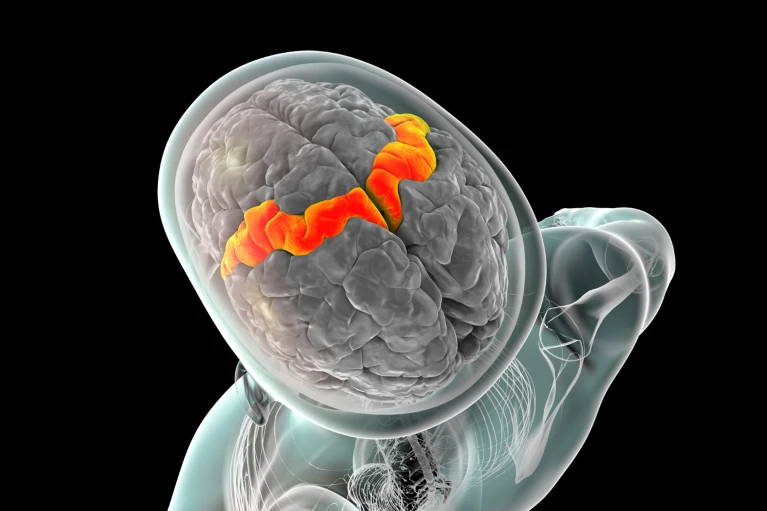

ֲ���\��Ƥ�ӵ�늘O������ӛ�һ���fԒ����������c�Z�����P�Ĵ��X��ӡ��DƬ��Դ��Kateryna Kon/Science Photo Library

ԓ�b�ñ��Q���X�C�ӿڣ�BCI������ʹ���˹����ܽ�a���c��ԇ�D�fԒ�r���X늻�ӡ�ԓ�b���ǵ�һ�����H���٬Fһ���˵���D��߀������Ȼ�Z��������BCI�����{�����ߡ���������Ȼ�Z�����������ڱ��_��˼����С�

��һ��о��У�һ�Nģ� ��c���������ĺϳ������څ��c����Ӱl���fԒ��D��̖��10����ȣ����f��������Ԓ�Z���@�6��11�հl���ڡ���Ȼ�����о��ɹ���־��������BCI���ش���M������BCIͨ����3���ݔ���Z��������ֻ�����Ñ�����ģ�M�������Ӻ���������Z����

“�@���Z��BCI�I���ʥ����”���m�R˹������ش�W��Ӌ���ƌW��Christian Herff�f��“�@���挍�ġ��l�ġ��B�m���vԒ��”

�@��о��ą��c����һ��45�q�����ԣ��ڻ���һ�N�\����Ԫ����——��ή�s����Ӳ���Y����ʧȥ�������fԒ���������@�N�������p�����Ƽ����\�ӵ��������fԒ��������mȻ��߀�ܰl�����fԒ�������vԒ������Ҳ�������

�ڰY����F5��������������g���ڿ����\�ӵĴ��X�^�����256����늘O��ÿ��1.5�����L��Փ������֮һ�������������၆��W���S˹��У���ƌW��Maitreyee Wairagkar��ͬ��Ӗ������ȌW���㷨��ÿ10���벶һ�������X�е���̖��������ϵ�y���r��a����ԓ����ԇ�D�l������������������Ҫ���_�ľ��w�~�Z���������——���ɿ��Z���~���Z���ӆ�λ��

“�҂������������~�Z���_�뷨���҂��иЇ@�~��߀������һЩ���_�Եİl�����@Щ�������҂����~�R������ˌ��F�@һ�c���҂��������@�N��ȫ�������Ƶķ�����”Wairagkar����f��

ԓ�F�߀ͨ�^Ӗ���˹������㷨���������c������ǰ�IJ��L��������ϳ����Ի���ʹ�� �������c���Լ�������

�о��ˆTҪ���c��ԇ�l��“��”“Ŷ”“��”֮ĸЇ@�~�����f��̓���Ć��~��BCI�ɹ��خa�����@Щ���������������ڲ���Ҫ�̶��~�R����r�������Z����

ʹ��ԓ�b�ã����c�߿���ƴ�����~���ش��_��ʽ���}����ʹ�ý�a��Ӗ������֮���һЩ���~�f�������f��Ԓ�������V�о��ˆT���ϳɵ����fԒ��“�е����d”�����X��������“�挍��”��

����������У�BCI�R�e�����c�������һ�������f���Ɇ���߀������䡣ԓ�b��߀���Д�����ͬһ��Ԓ�Џ��{��Щ�~�Z�����������{����ϳ��Z�����Z�{��“�҂�������������Z���������@Щ�dz���Ҫ�IJ�ͬԪ�ء�”Wairagkar�f����ǰ��BCIֻ�ܮa�����{���Z����

��ʿ�Ճ��ߴ�W�����̎�Silvia Marchesotti�f��ԓ�b�õĹ���“����δ�����ߵ��ճ�ʹ�����P��Ҫ”��“��ij�N���x���f���@��һ�N��ʽ�D׃����������������һ�N�F�������еĹ��ߡ�”

���PՓ����Ϣ�� https://doi.org/10.1038/s41586-025-09127-3

�Ї�-��ʿ�˲žW�l��

����ʾ�������Wע������Դ��XXX������/�D�ȸ�������W�D�d���ڂ��f������Ϣ������a�I̽ӑ֮Ŀ�ģ�������ζ����վٝͬ���^�c���C������ݵ��挍�ԣ������݃H��������